2023年12月にAIマネジメントシステムの国際規格ISO/IEC 42001(以下、AIMS)が発行されました。このコラムではAIMSがAIに関する各種文書の中でどのような位置づけなのか及びISO/IEC27001情報セキュリティマネジメントシステム(以下、ISMS)と比較した場合の特色を説明します。

AIMSの位置づけ

AIガバナンスに関する文書は、世界各地の様々な機関から発行されています。これらの文書は大きく分けて「原則(Principles)」と「フレームワーク(Frameworks)」の二つに分類されます。

“原則”は、「公平性」、「透明性」、「プライバシーの尊重」といった行動や意思決定の際に拠り所となる価値観を提供するものです。

抽象的な内容で具体的な実施事項までは書かれていません。OECDの「AI原則」や「公正な情報慣行原則」などがこれに該当します。

“フレームワーク(Frameworks)”は、原則に示された価値観を実現するための具体的な手順が記載されたものです。AIMSや「NIST AIリスクマネジメントフレームワーク」などがこれに該当します。

なお、総務省・経産省の「AI 事業者ガイドライン」は、基本理念・原則に加え、実施すべき事項も書かれているため、”原則”と”フレームワーク”の両方を兼ね備えたものと言えます。

ISMSとの類似点

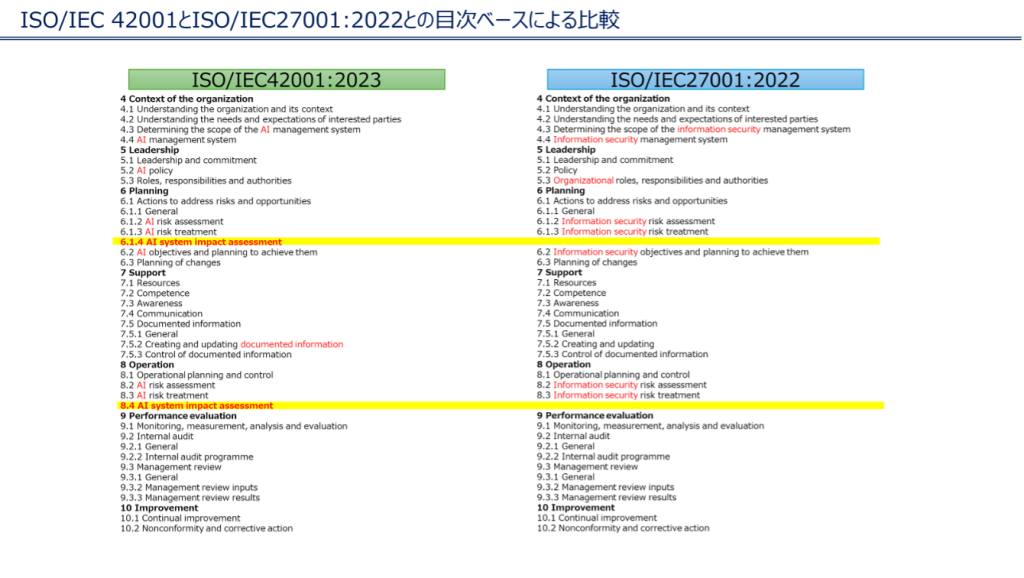

AIMSは利用者の利便性を考慮し、ISMS等既存のマネジメントシステム規格と同じ構成で要求事項が規定されています。この構成が、日本のメンバーから提案されたことは特筆すべき点です。

上図は、AIMSとISMSを目次ベースで比較したものです。ISMSで情報セキュリティと記載されている部分がAIに置き換わる程度で、その他については後述する一点を除いて全く同じ構成になっています。

AIMSとISMSの相違点

AIMSをISMSと比較した場合の相違点は、AIMSは「AIシステムインパクトアセスメント」を求めており、組織や利用者等個人だけでなく、社会への影響までアセスメントするよう要求している点です。また、要求事項の中では”気候変動”についても考慮するよう記載されています。下表は、社会や環境への影響に言及している要求事項を一部抜粋したものです。

| 箇条 | 要求事項 |

|---|---|

| 4.1 組織及びその状況の理解 | 組織は、気候変動が関連する問題であるかどうかを判断しなければならない。 |

| 4.2 利害関係者のニーズ及び期待の理解 の注記 | 利害関係者の要求事項には、気候変動に関する要求事項を含める場合がある |

| 6.1.2 AIリスクアセスメント | 特定されたリスクが顕在化した場合に、組織、個人、社会にもたらされる潜在的な影響を評価する |

| 6.1.4 AIシステムインパクトアセスメント | 組織は、AIシステムの開発、提供、使用から生じ得る、個人もしくは個人のグループ、またはその両方、および社会に対する潜在的な影響を評価するプロセスを定義しなければならない AIシステムインパクトアセスメントは、AIシステムの導入、意図された使用、予見可能な誤用が、個人もしくは個人のグループ、またはその両方、そして社会に及ぼす潜在的な影響を判断するものとする。 |

” AIシステムインパクトアセスメント”は“AIリスクアセスメント”とは別の要求事項です。AIリスクアセスメントはISMSの“情報セキュリティリスクアセスメント”と同じ項番で、AI目的の達成を支援または妨げるリスク”と自組織のリスクの特定に主眼が置かれています。

一方、”AIシステムインパクトアセスメント”は組織外の個人やグループ、社会への影響を評価することを求めています。AIによる差別、ディープフェイクによる社会の混乱、大量の電力消費による環境への影響等が世界の共通課題となっていることから、AIMSでは気候変動についての考慮や、社会や環境への影響評価が明示的に求められていると想定します。

AIMSの認証について

2024年5月22日時点では、正式な認証制度はありません。認証機関の要件を規定するISO/IEC42006は、ドラフト(DIS)段階であり、今後ファイナルドラフト(FDIS)を経て発行されていく見込みです。ISMS等の認証機関になっている一部の企業においては、正式な認証審査に向けたギャップ分析サービス等を提供しているようです。

EU AI法成立の影響

2024年5月21日EU AI法が成立しました。AI法によってAIMSはどのような影響を受けるのでしょうか。EU AI法は皆様ご承知の通りAIシステムを下記の4つに分類しています。

①禁止されたAI

②ハイリスクAI

③限定リスクAI

④最小限リスクAI

また、生成AIの登場によって、この4分類とは別に汎⽤AIというカテゴリーもできました。このうちハイリスクAIについては「リスクマネジメントシステムの構築」が、汎用目的AIについては「システミックリスク(※)の評価・軽減」が事業者の義務として課されます。

つまり、AIMSはEU AI法によって不要になる存在でも、全く別のことを求めている訳ではなく、AIMSの構築・運用はEU AI法がまさに要求していることなのです。AIMSはEU AI法への適合のために参照すべき文書と言えるかもしれません。

※「システミックリスク」とは、汎⽤⽬的AIモデルの⾼インパクト能⼒に特有のリスクであって、その影響範囲の広さにより連合市場に重⼤な影響を及ぼし、または公衆衛⽣、安全、治安、基本権もしくは社会全体に対する実際の若しくは合理的に予⾒可能な悪影響により、バリューチェーン全体にわたって⼤規模に伝播し得るリスクをいう。

AIMSさえ見ればよいのか

AIMSはEU AI法への適合のために参照すべき文書と言いましたが、AIMSさえ見ていればAIガバナンス、マネジメントができていると言えるのでしょうか。残念ながらそうではありません。

AIMSの全体構成は次のようになっています。

付属書Aの管理策のテーマを見ていただくと、ISMSと比較してAI固有の具体的な管理策がありません。強いてあげると、AIによるバイアスにつながる「AIシステム用データ」は一見のAI固有の管理策ですが、その中身は例えば「AIシステムで使用するデータの取得と選択に関する詳細を決定し、文書化しなければならない。」など文書化要求事項が並んでいるだけであり、どのようにデータを選択すべきかまでは細かく書かれていません。

したがってAIMSだけを参照するというのは不十分で、日本の「AI 事業者ガイドライン」だったり、シンガポールの「Model AI Governance Framework」だったり、はたまた他社が公開しているAIガバナンスのベストプラクティスを参照して、自社の管理策を定めていく必要があります。当社も加盟しておりますが、AIガバナンス協会のような団体に入って他社のAIに関する取組の共有を受けたり、また自社の取組を共有し意見をもらうことも有用だと思います。

まとめ

AIを自組織で扱う際には、自組織や自組織のサービスの利用者だけでなく、広く社会や環境への影響も見ていく必要があります。これには、今までの情報セキュリティ、個人情報保護の知見だけでは対応が困難です。国内外の法・ガイドラインの動向や他社の取組をチェックする必要があります。時には専門家の力もうまく使いながら様々なリスクを想定し行動することが一層求められます。